|

纽约大学石溪分校顾险峰教授2018年7月18日VALSE Webinar 成功举办。

顾险峰,1989年考入清华大学计算机科学与技术系,基础理论方向,班主任黄连生教授。1992年获得清华大学特等奖学金。后于美国哈佛大学获得计算机博士学位,师从国际著名微分几何大师丘成桐先生。目前为美国纽约州立大学石溪分校计算机系终身教授,哈佛大学数学科学与技术中心客座教授。曾获美国国家自然科学基金CAREER奖,中国国家自然科学基金海外杰出青年奖(与胡事民教授合作),“华人菲尔茨奖”,晨兴应用数学金奖。丘成桐先生和顾险峰博士团队,将微分几何,代数拓扑,黎曼面理论,偏微分方程与计算机科学相结合,创立跨领域学科“计算共形几何”,并广泛应用于计算机图形学,计算机视觉,几何建模,无线传感器网络,医学图像等领域。目前已经发表二百篇余篇国际论文,学术专著包括“Computational Conformal Geometry”(计算共形几何), “Ricci Flow for Surface Registration and Shape Analysis”等。

顾险峰教授Webinar的题目为:Geometric View to Deep Learning.

最近顾险峰团队在深度学习领域提出一个新颖的观点,即通过几何视角来研究深度学习。在报告中,顾险峰教授主要介绍了为什么深度学习可以work,深度神经网络如何学习一个流形,以及深度学习如何控制概率分布。

问答部分:

问题1:为什么要把GAN的特征空间变成正态分布? 回答:VAE和GAN,它在隐空间的话都希望把数据分布变成正态分布,因为回到刚才这个模型的话,我们可以看到,通过学习之后,你把这个流形映射到了隐空间上,但是你对这个隐空间上的区域没有控制,它的形状可能是非常irregular。但是如果你想生成一个模型,生成一张图片,如果采样点白噪声选在参数domain之外,你得到的结果是不make sense的。那么我们为了使这个区域变得非常regular,然后想控制这个上面的采样均匀,我们必须要在这个特征空间进行一些变换。

问题2:用流形去研究深度神经网络对于计算机系的博士生来说合不合适呢?因为先把流形学会得花不少时间,然后如果以发文章为目的的话是否还有很多东西供非数学系的同学去研究呢? 回答:如果我们做深度学习,那么至少会对背后的principal有一个大致的理解,如果非常工程地做的话会比较盲目,会浪费很多时间,那么我们觉得这个流形的分布定律是可以用来解释机器学习成功的一个核心原因之一,对一些基本流形知识掌握的话对于以后设计实验、提出一个research方向还是会有很大的帮助的。

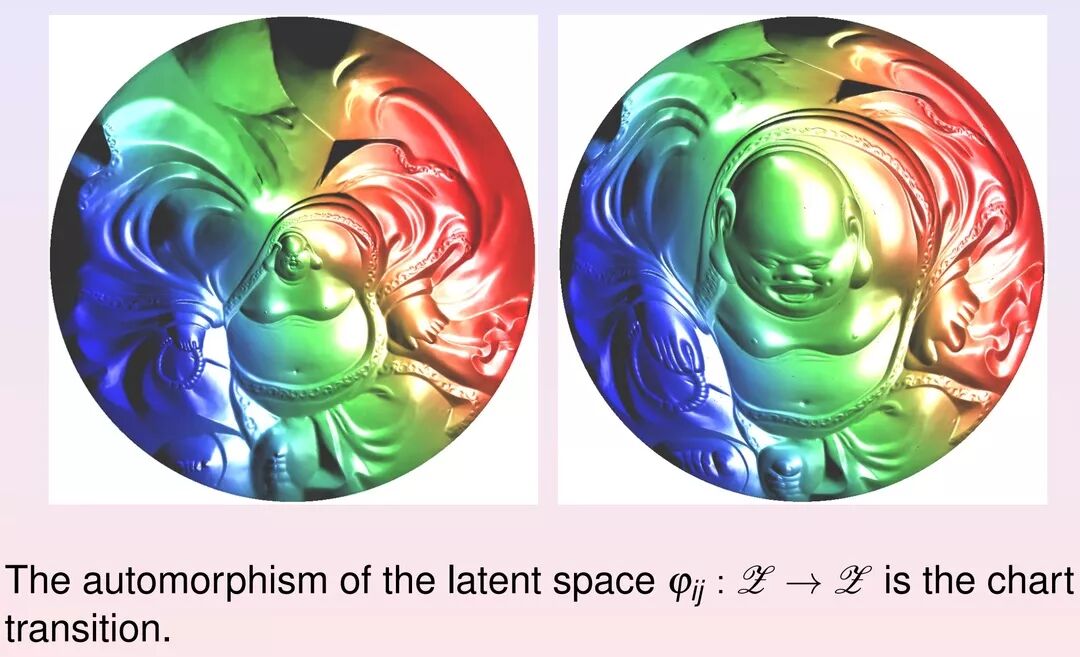

问题3:数据不一定是正态分布。 回答:这是对的。数据分布肯定不是正态分布。我们核心是说通过变换把数据分布映到隐空间,然后使得数据分布在隐空间是正态分布。这话怎么理解,我们可以再看刚才弥勒佛的例子(图1)。我们把弥勒佛的曲面映到平面上来,相当于你做了编码映射。编码映射之后实现了降维。然后,弥勒佛上面的面元可以看成是概率分布。那这个面元在平面分布这两个图像上是完全不同的,在右侧它是均匀分布,在左侧它不是均匀分布。核心是我们通过调节在平面的映像使得弥勒佛本身的面元在平面上变得均匀分布,那么这是我们所作的目的。  图1

问题4:对于高维数据,是否用GMM代替单个Gaussian的假设更合理? 回答:其实是如果用最优传输理论的话,我们可以实现任意两个概率分布之间的变换,我们不care最终的target变换是Gaussian的还是uniform,还是任意理论变换,任意的一个概率分布都可以的。

问题5:刚才提到GAN的竞争是没有必要的,但是如何得到最优的G或者D呢? 回答:它是这样的,目前的话,用L1 distance ,这个竞争是有必要的,不可避免的;因为在那个模型下,G和D没有必然的数学联系;如果用L2,G和D彼此等价,那么在这种情况,只优化其中一个,达到最优,就可以把另外一个写出来,那么两个同时算,一定要彼此交流信息。比如说,先算D,再转G,或者先算G,再算D,一定要有内部信息交流;否则的话,完全不交流,直接竞争,实际是比较低效的,这就是我们的point。

问题6:任意概率分布不是都可以用均匀分布变换得到吗?为什么还要训练? 回答: 这个问题就是说,比如看我们目前这幅图(图1),左侧的话呢,如果我们考虑曲面的面元,它在平面上的分布不是均匀的,我们可以看到头部的话它的density非常高,肚皮这个地方,density非常低,右侧的话,它是均匀分布,但要想求出从左侧到右侧这个变换,实际是非常困难,要求解非常非线性的PDE,理论上,这个变换一定存在,但是工程上,我们要把它算出来,这个计算过程就相当于训练过程。

问题7:如果用L1距离的话,就是WGAN,那这样生成模型和判别模型就没有那种解析关系了吧? 回答:对的,用L1的情况下,没有那么完美的关系,用L2是存在的。那么对于大多数应用的话,用L1,L2没有本质差别。

问题8:“网络复杂度大于流形复杂度”,这个复杂度怎么计算? 回答:这个问题非常好,就是说我们目前对于网络复杂度给了一个上界,这个上界比较粗糙,那么如何得到更精细的估计是比较有意思的问题。流形的复杂度的计算也是比较困难的,现在只能用组合方法来进行估算。这两个复杂度的精确计算的算法,我们觉得值得深入进行研究。

问题9:如果G和D,有其中一个就可以计算另一个的话,那G/D单个本身怎么学习呢?另外比如学出来最优的G/D之后,另一个D/G具体怎么推算出来? 回答:在我们刚才的框架下,generator相当于求解Brenier势能函数,本质上等价于求解蒙日安培方程,蒙日安培方程最终归结为求upper envelope,求上包络,最后归结为上包络怎么求。然后我们给出了一种能量,通过优化能量可以得到离散的最优传输映射。这边(图1)我们可以看到左边这个图映到右边的图等价于求一个generator,求解最优传输映射,这是用我们的理论,完全用几何方法算的。这个方法在高维的推广实际上就回答了这个问题。

问题10:ReLU函数是不是线性函数,经过ReLU不是线性变换了吗? 回答:ReLU函数不是线性函数。ReLU网络代表的是分片线性变换,整体并不是线性的。

问题11:“网络复杂度大于流形复杂度”能够推导出网络越复杂越好吗? 回答:当然不是,网络复杂度大的话,计算量也大,对于存储要求也比较大,有时过拟合,肯定还是适中比较好,但我们需要对网络的学习能力有一个大致的估计,对所学习问题的规模和难度有一个大致估计,这是我们想达到的目的。

问题12:刚才提到GAN在几何上的解释,如果直接利用几何方法,是不是可能有优于统计方法的解呢? 回答:我们给出这个几何方法,然后这个通过几何方法等价于最优几何映射中的Brenier理论,最优传输映射本质上属于统计方法,属于概率论方法,只是说我们对概率论方法有着一个几何的理解,更加直观,也更加容易计算,本质上还是归结于统计方法。用这种方法也可以吸引很多统计学的研究,比如说我们如何把一个概率分布转化成另一个概率分布,解的存在性,唯一性还有构造性,都可以用这个方法解决。在传统意义下,用KL散度来衡量两个概率密度之间的距离实际上比Wasserstein距离要差一些,如果这两个概率分布的support没有交集,他们KL散度的距离一直等于常数,所以梯度消失,但是它们的Wasserstein距离不是常数,两个support越接近,距离越小,所以大家希望采用Wasserstein距离而不是KL散度。

问题13:请问采用AE-OMT取得了较好的结果,那这种方法有没有它的不足或局限性? 回答:它有它的不足,就是我们计算给出的这个几何算法对于高维来讲还是比较复杂的,因为如果我们想表达一个三角剖分,当维数升高的时候,这个三角剖分的组合复杂度的增长是十分迅速的,目前来讲还没有强大的code能真正计算这种高维的upper envelope,但是它存在一种等效的方法,或者是其他近似方法,比如说,sliced OMT,sink hole method,还有传统的Kantorovich approach方法,所以就有很多种替代性算法。

问题14:凸面元的高度的改变,会不会影响凸面元的边界,进而影响周围的面元? 回答:是的,凸面元的改变影响自身的投影面积,然后也影响周围所有和它相连的面的面积。

问题15:隐空间是欧氏空间或者是别的比如超球面,对结果有影响吗? 回答:当然有影响,比如有一个m维的流形,通过我们的encode把它映射到m维欧氏空间的一个区域,这对于所能学习的流形拓扑产生强烈的限制,比如输入的流形是一个m维的球面,那么用auto-encode学不出来,我们从拓扑上讲,我们没有办法把一个球面映射到一个平面,它们之间不存在拓扑映射,所以我们只能学拓扑复杂流形的一个局部参数域,或者一个local chart,这也是一个问题,所以全局学习流形是否能够学到,后面用到很多拓扑学的知识,目前仍然是一个问题。

问题16:有哪些实际的应用问题不能用原有的理论来解决,而只能用你们的理论来解决? 回答:在我们的ppt中给出了很多低维的例子,最简单的例子,这个例子在别的领域中有很大应用,如图(图1),左侧这个变换叫保角参射化,我们把曲面映到平面上来,这些映射是保持角度不变,我们在曲面上任意画两条曲线有交角,通过映射的话,平面上两条曲线交角不变,所以说这个变换叫保角变换,右侧是保面积变换,就是说我们在曲面上画一个区域,然后对应参数域上的区域两者面积相等,那么你想算这种变换必须用我们目前的理论,除此之外的话不存在其它理论,你当然可以用auto encode,来实现三维到二维的变换,但是你没办法精确算出它的面元,当然这是属于图形学中必须用到这个理论的例子。

问题17:怎么从左边的弥勒佛变成右边的均匀的呢? 回答:第一步,从左边到右边用到计算共形几何的方法,比如Ricci-flow,我的课上会讲,可以实现从3维到2维的降维。第二步,从保角变换到保面积变换,这一步要要用到最优传输映射,就是我刚才提到的方法,求上包络算法。

录像视频在线观看地址: http://www.iqiyi.com/u/2289191062

PPT下载地址:

http://vision.ouc.edu.cn/valse/slides/20180718/valse_talk_07_18_2018.pdf

特别鸣谢本次Webinar主要组织者: VOOC责任委员:刘日升(大连理工) VODB协调理事:王瑞平(中科院计算所)

活动参与方式: 1、VALSE Webinar活动依托在线直播平台进行,活动时讲者会上传PPT或共享屏幕,听众可以看到Slides,听到讲者的语音,并通过聊天功能与讲者交互; 2、为参加活动,请关注VALSE微信公众号:valse_wechat 或加入VALSE QQ群(目前A、B、C、D、E、F、G群已满,除讲者等嘉宾外,只能申请加入VALSE H群,群号:701662399); *注:申请加入VALSE QQ群时需验证姓名、单位和身份,缺一不可。入群后,请实名,姓名身份单位。身份:学校及科研单位人员T;企业研发I;博士D;硕士M。 3、在活动开始前5分钟左右,讲者会开启直播,听众点击直播链接即可参加活动,支持安装Windows系统的电脑、MAC电脑、手机等设备; 4、活动过程中,请不要说无关话语,以免影响活动正常进行; 5、活动过程中,如出现听不到或看不到视频等问题,建议退出再重新进入,一般都能解决问题; 6、建议务必在速度较快的网络上参加活动,优先采用有线网络连接; 7、VALSE微信公众号会在每周一推送上一周Webinar报告的总结及视频(经讲者允许后),每周四发布下一周Webinar报告的通知及直播链接。

|